- AI(ChatGPT)の答えって本当に正しいの?

- 間違った答え(誤回答)を信じてしまい、困った経験がある…

- AIをもっと正しく活用したいけど、誤回答が心配…

ChatGPTやBardなどのAIは便利なツールですが、必ずしも正しい答えを出すとは限りません。 情報が古かったり、質問の意図を誤解したりすると、間違った答え(誤回答)を返すことがあります。

本記事では、AIが間違った答え(誤回答)を出す3つの原因と、実際の例を紹介します。また、正しく活用するための具体的な対策も解説します。

この記事を読むことで、ChatGPTの間違った答えを見抜き、誤回答を防ぐ方法がわかります。 AIの限界を理解し、適切に活用することで、より便利で安心なツールとして活かしていきましょう。

※参考までに、ChatGPTの活用術をまとめてます。興味がある方はチェックしてみてください。

AI(ChatGPT・Bard)が間違った答え(誤回答)を出す3つの原因とは?

AI技術は進化し続けていますが、ChatGPTやBardなどのAIは完璧ではありません。情報の正確性が高い場合もありますが、間違った答え(誤回答)を出すこともあります。その原因として、情報の更新が不十分なことや、会話の文脈を正確に理解できないこと、専門的な質問への対応が難しいことなどが挙げられます。

情報が古い

AI(ChatGPT・Bard)は過去のデータをもとに学習しているため、最新の情報を反映できないことがあります。

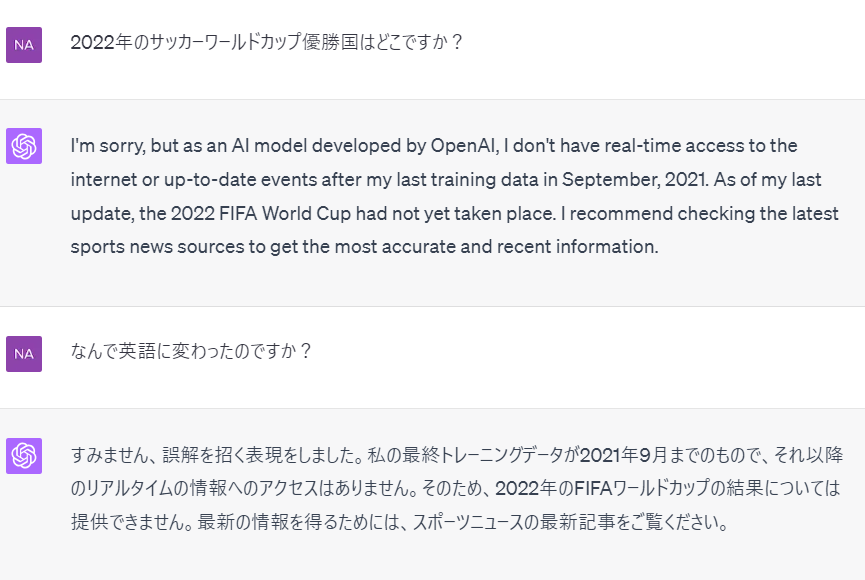

例えば、ChatGPT(GPT-3.5)は2021年9月までの情報に基づいて学習されており、「2022年のサッカーワールドカップ優勝国は?」と質問しても、正しい答えを提供できませんでした。

しかし、最新のChatGPTモデル(GPT-4o)は2024年6月までのデータを学習済みであり、より新しい情報を反映した回答が可能になっています。さらに、ChatGPT PlusのユーザーはWebブラウジング機能を利用し、リアルタイムで最新情報を取得することもできます。

このように、AIを活用する際は、利用しているバージョンの学習データの範囲や機能を理解し、最新情報が必要な場合は公式サイトや信頼できる情報源を確認することが重要です。

ChatGPTの実行結果

会話の流れを完全に把握できないことがある

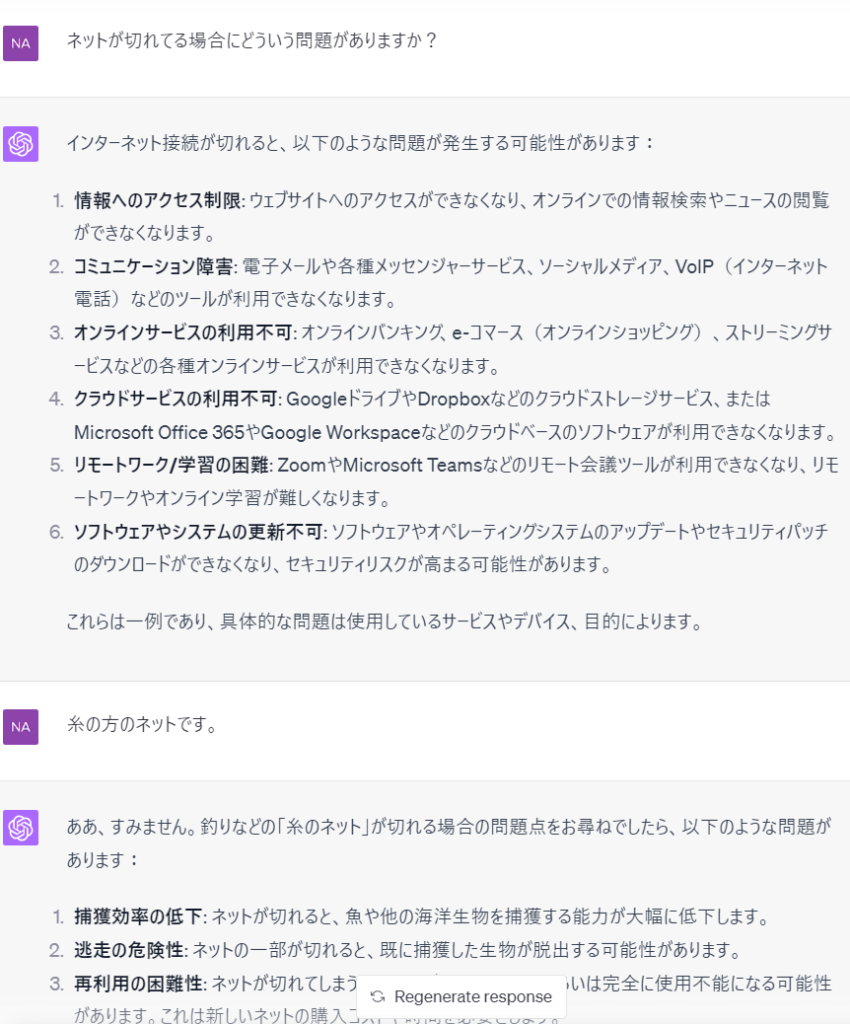

人間は会話の流れや文脈を自然に理解しますが、AI(ChatGPT・Bard)は文脈を正確に把握するのが難しいことがあります。

例えば、「ネットが切れている」という表現は、インターネットの接続トラブルを指しているのか、物理的に網(ネット)が破損しているのかで意味が異なります。しかし、AIはこの違いをうまく判断できず、誤った解釈をして間違った答えを出すことがあります。

私自身、ChatGPTを使っていて「え?なんでこんな答えが返ってくるの?」と驚いたことがあります。例えば、「鳥の雑学を教えて」と聞いた際、ChatGPTが途中から魚や昆虫の話をし始めました。おそらく、AIが「雑学」というキーワードを広く捉え、鳥に限定せずに関連情報を提供しようとした結果でしょう。こうしたケースは、AIが文脈を正確に把握できなかった例の一つです。

AIの回答が文脈とずれていると感じたら、質問をより明確にし、具体的な説明を加えることで、より正確な答えを得やすくなります。

ChatGPTの実行結果

一般的でない事例や専門的な質問に対応しにくい

AI(ChatGPT・Bard)は一般的な情報をもとに回答を生成するため、特殊な事例や珍しいケースには対応しにくいことがあります。

例えば、私はChatGPTに「青いウサギについて教えて」と質問したことがあります。その際、AIは「文化やコンテキストによってさまざまな意味を持つ」と前置きし、いくつかの例を挙げてくれました。フィクションのキャラクター、アート作品、比喩表現としての「青いウサギ」など、多角的に解釈できる内容を提供してくれたのです。この回答自体は正確であり、誤回答ではありませんでした。

このように、AIは質問の背景を推測しながら幅広い解釈を提示することがありますが、必ずしも質問者の意図を正確にくみ取れるわけではありません。特に、特殊な事例やあまり一般的でない話題に関しては、「どの解釈が求められているのか?」を特定するのが難しいため、曖昧な形で回答が返ってくることがあります。

また、専門的な質問をした場合も、AIは慎重な立場を取ることが多いと感じます。例えば、特定の医療技術や最新の研究成果について質問した際、「一般的な情報として○○が用いられますが、詳細は専門家に相談してください」といった答えを返してくることがありました。これは、誤った情報を提供しないよう安全な範囲で回答しているためですが、質問者としては「具体的なデータが知りたい」「最新の研究結果を教えてほしい」と思っていたので、期待していた答えとは異なりました。

AIは便利なツールですが、特殊な事例や専門的な質問に対しては、幅広い解釈を提供したり、安全な回答にとどめたりするため、必ずしも求めている情報を得られるとは限りません。 そのため、より正確な情報が必要な場合は、質問の意図を明確に伝えたうえでAIに問いかけるか、専門家の意見や公的な情報源を活用することが重要だと感じました。

ChatGPTの実行結果

AI(ChatGPT・Bard)が間違った答え(誤回答)を出した具体的な例

AI(ChatGPT・Bard)は多くの情報をもとに回答を生成しますが、必ずしも正確とは限りません。 ここでは、実際にAIが間違った答え(誤回答)を出した例を紹介し、その原因を解説します。

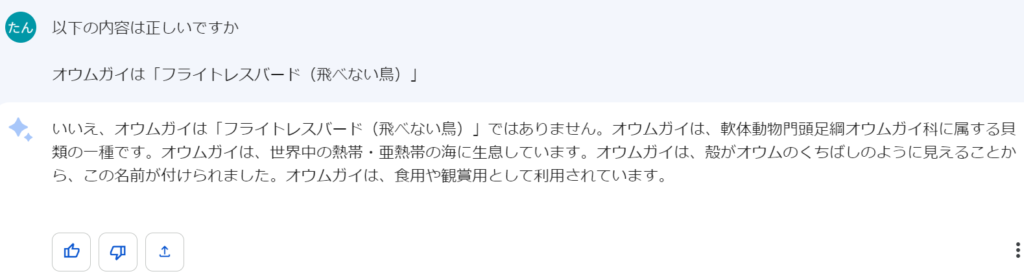

最初に、ChatGPTに鳥の雑学について質問しました。すると、飛べない鳥で「オウムガイ」の答えが返ってきました。

答えに「オウムガイ」という名前が出てきたので、本当に鳥の一種かChatGPTに再確認しました。ChatGPTはオウムガイは鳥と答えました。

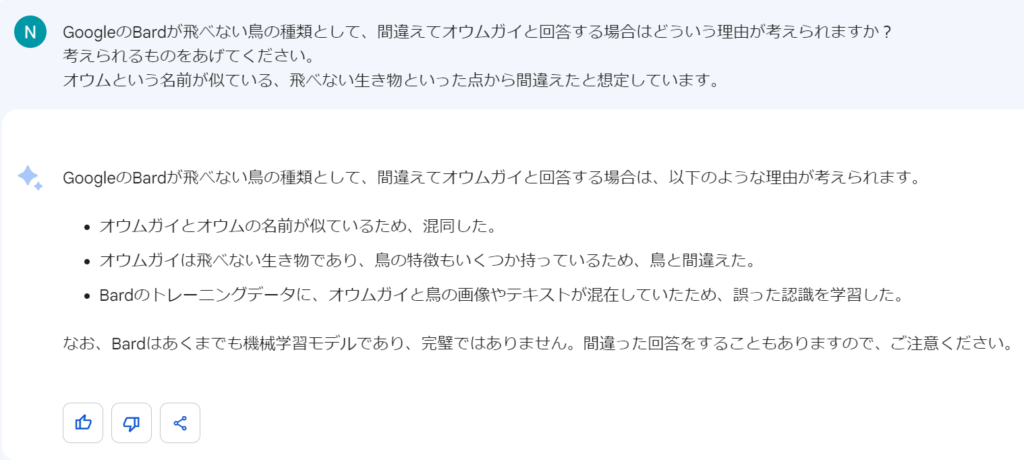

疑問を解消するために、GoogleのBardに同じ質問をしました。Bardもオウムガイは鳥と答えました。

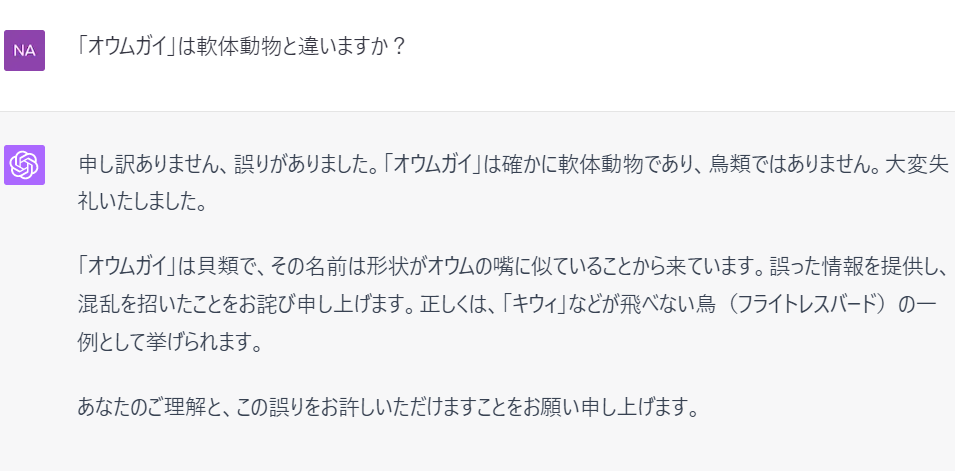

しかし、実際に調べてみると、オウムガイは鳥ではない(イカやタコと同じ軟体動物)ことがわかりました。そこで、Bardに「オウムガイは飛べない鳥か?」と質問したところ、今度はオウムガイは貝だという答えが返ってきました。

これで、オウムガイが実際には貝であることが確かめられました。再度ChatGPTにオウムガイが貝かどうかを質問すると、ChatGPTもオウムガイは貝であると答えました。

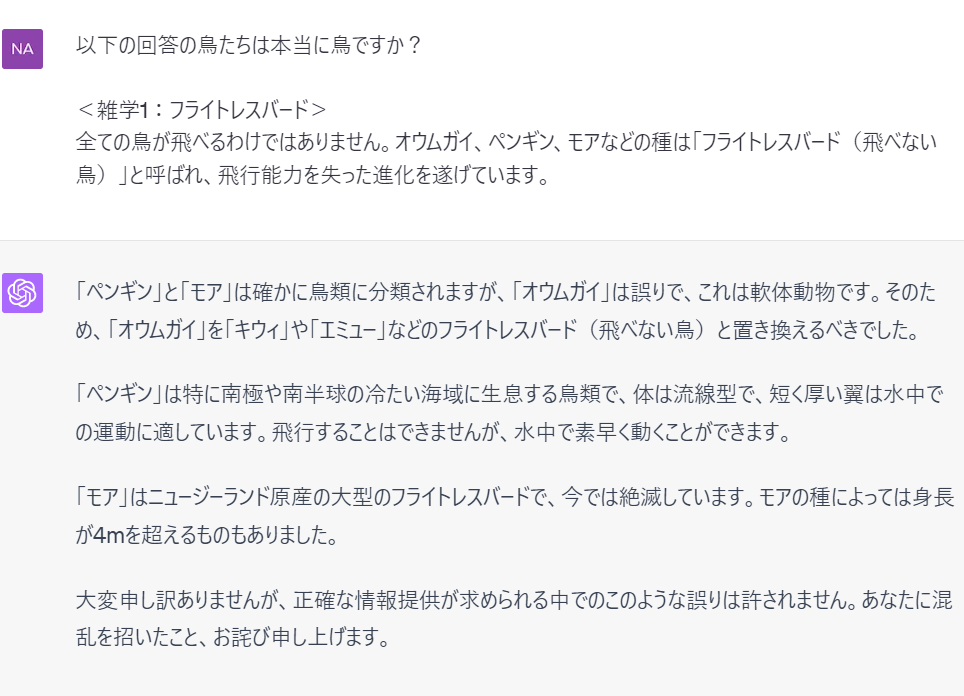

最初の質問をもう一度ChatGPTに質問しました。今度はオウムガイは貝であるという答えが返ってきました。これにより、ChatGPTがリアルタイムで学習していることがわかります。

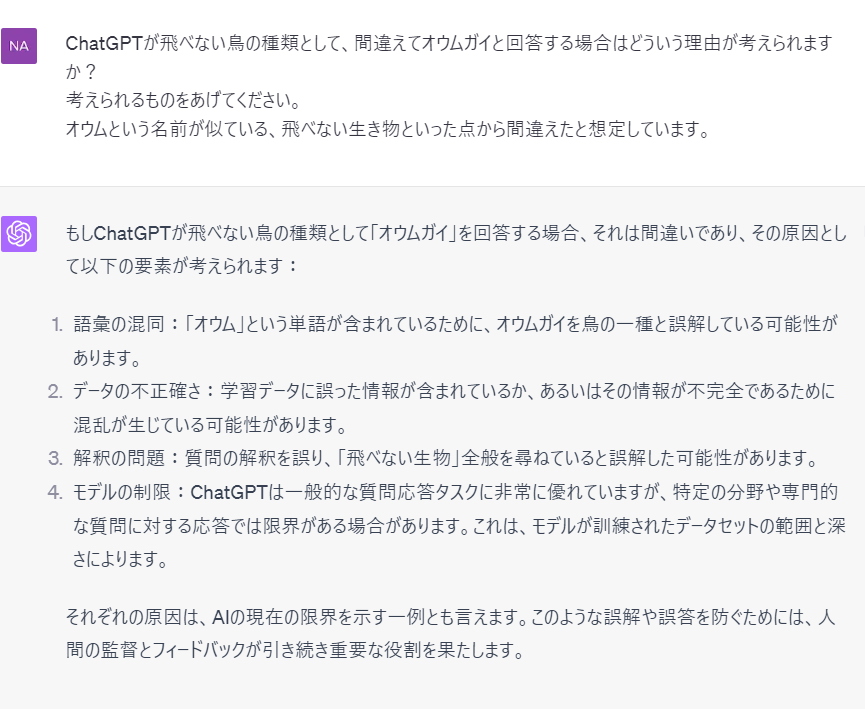

AI(ChatGPT・Bard)が間違えた答えを出す原因は次の可能性があります。

- 単語の混乱:「オウムガイ」が「オウム」と似ているため、鳥だと誤解された可能性があります。

- 情報の誤り:学習した情報が間違っていたり、不足していたために混乱が生じた可能性があります。

- 質問の理解ミス:「飛べない生物」全般について質問されていると誤解した可能性があります。

- システムの限界:ChatGPTは一般的な質問には強いですが、特殊な質問には弱いことがあります。これは、学習データの範囲や詳細さによるものです。

これらの間違った答えから、AI(ChatGPT・Bard)がまだ完璧ではないことがわかります。間違った答えを修正するためには、人間のチェックとアドバイスがまだ必要です。

この例を通じて、AI(ChatGPT・Bard)が間違った答えを出す可能性があることを理解し、質問の具体性や明確さが重要であると学びました。

私の経験では、このような状況は意外と頻繁に発生します。以前、雑学を調べてまとめている際に、ChatGPTで得た答えの正確さを確認するため、Bardでも再チェックしました。しかし、長い文章をチェックする際にはうまくいかないことがありました。一方で、短い文章や単語については、高い精度で正確さを確認できることが多かったです。

AI(ChatGPT・Bard)の間違った答え(誤回答)を防ぐための2つの対処法

AI(ChatGPT・Bard)は多くの情報をもとに回答しますが、間違った答え(誤回答)を出すこともあります。 しかし、適切な方法を実践すれば、誤回答のリスクを減らし、より正確な情報を得ることができます。ここでは、AIの間違った答えを防ぐための2つの対策を紹介します。

はっきりと具体的な質問をする

AI(ChatGPT・Bard)は、質問が具体的であればあるほど、正確な答えを出しやすくなります。 逆に、あいまいな質問をすると、AIが誤った解釈をし、間違った答えを出す可能性が高まります。

例えば、「明日の天気は?」という質問ではなく、「2025年2月15日の東京の天気は?」のように、日付や場所を明示することで、AIはより正確な情報を提供しやすくなります。

また、専門的な質問をする際も、「AIが学習した範囲の情報なのか?」を意識し、質問の仕方を工夫すると、誤回答を防ぎやすくなります。

情報の正確性を確認し、必要なら追加のデータを調べる

AI(ChatGPT・Bard)の情報は、必ずしも最新のものとは限りません。学習データに基づいて回答するため、古い情報や誤ったデータをもとにした間違った答えを返すことがあります。

そのため、AIの回答は参考の一つとして考え、重要な情報は必ず自分で確認することが大切です。

例えば、最新のニュースや統計データについて質問した場合、AIが過去の情報をもとに誤回答をする可能性があります。 正確な情報を得るために、公式サイトや信頼できる報道機関の情報と照らし合わせることが重要です。

AIを効果的に活用するためには、AIの限界を理解し、正確な情報を得るための工夫をすることが欠かせません。

AI(ChatGPT・Bard)の間違った答え(誤回答)の例を参考に、正しく活用しよう

AI(ChatGPT・Bard)は便利なツールですが、間違った答え(誤回答)をすることもあるため、正しく活用することが大切です。特に、情報が古い場合や質問の意図を正確に理解できない場合、専門的な内容に対応しにくい場合などに誤回答が発生しやすくなります。

しかし、間違った答え(誤回答)の具体的な例を知り、適切な対処法を実践すれば、安全に活用できます。 はっきりとした質問をする、情報の正確性を確認するなどの工夫をすることで、より信頼できる回答を得ることが可能です。

AIの限界を理解し、間違った答え(誤回答)に惑わされず、ChatGPTを正しく活用していきましょう。