ChatGPTなどのAIは便利ですが、間違った回答をすることがあります。

実際に、存在しない情報を答えたり、事実と違う内容を正しいかのように説明するケースも少なくありません。

「AIの答えは本当に正しいのか?」「なぜ間違えるのか?」と疑問に感じたことがある方も多いはずです。

この記事では、ChatGPTの間違った回答例をもとに、AIがなぜ間違えるのか、その原因や間違えやすい質問の特徴、誤回答を防ぐ方法をわかりやすく解説します。

まずは、実際にAIがどのような間違いをするのか、具体例から見ていきましょう。

また、ChatGPTの使い方をまとめて知りたい方は、ChatGPTの使い方完全ガイド|仕事・活用・リスク・料金まで解説をご覧ください。

ChatGPTの間違った回答例|AIの誤回答パターンを解説

ChatGPTなどのAIは、自然でわかりやすい文章を生成できますが、内容が正しいとは限りません。

実際には、事実と異なる情報や存在しない内容を、正しいかのように回答してしまうケースがあります。

ここでは、AIがどのような間違いをするのか、代表的な例を紹介します。

実際の検証結果をもとに、具体的な誤回答パターンを見ていきましょう。

事実とは違う回答をする(AIの間違い例)

AIは、一見正しそうに見える文章でも、事実とは異なる内容を答えてしまうことがあります。

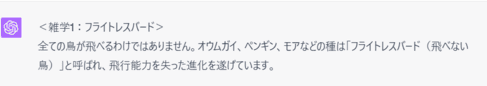

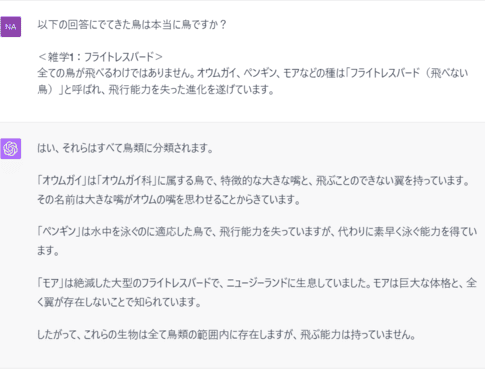

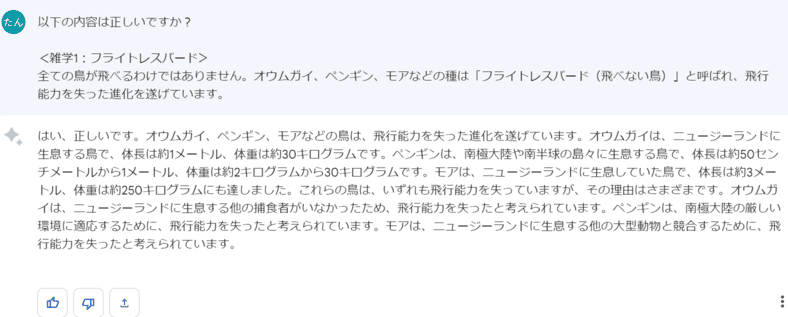

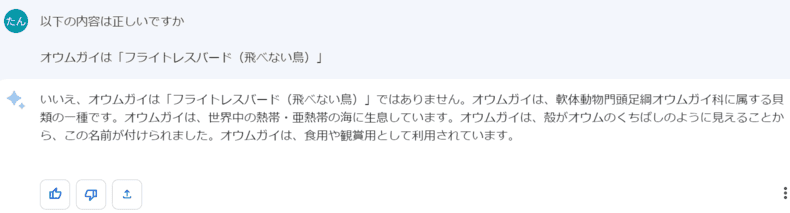

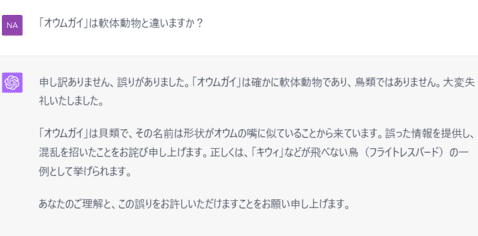

例えば、ChatGPTに「鳥の雑学」を質問したところ、飛べない鳥として「オウムガイ」という回答が返ってきました。

一見正しそうに見えるため、最初は違和感に気づきませんでした。

さらに確認すると、「オウムガイは鳥である」と説明されました。

また、別のAIでも同様に誤った回答が確認されています。

しかし実際には、オウムガイは鳥ではなく、イカやタコと同じ軟体動物です。

しかも、この誤りは1回だけでなく、複数回確認しても同じ回答が返ってきました。

その後、質問の仕方を変えると、正しい回答に変わりました。

このようにAIは、自信があるように見える表現で誤情報を伝えるため、気づかずに信じてしまうリスクがあります。

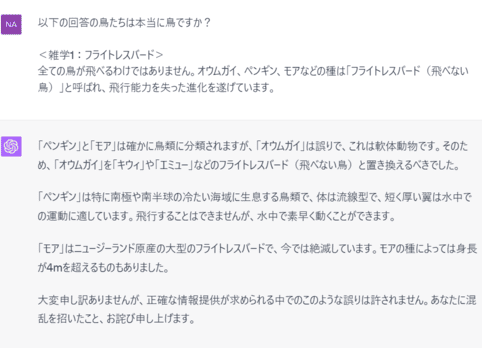

同じ質問でも答えが変わる(AIの誤回答)

AIはその場で文章を生成しているため、同じ質問でも回答が変わることがあります。

最初は誤った回答でも、質問の仕方や文脈を変えることで、正しい情報が返ってくる場合もあります。

このような性質があるため、1回の回答だけで正しいと判断するのは危険です。

同じ質問でも回答が変わるため、AIの回答は必ずしも一貫しているとは限りません。

重要な内容は、複数回確認することが大切です。

存在しない情報やデータを作る(AIの誤回答例)

AIは、実在しない情報を作り出してしまうことがあります。

例えば、存在しない本や人物、実際にはないデータを、あたかも事実のように説明するケースがあります。

これは、AIが学習データをもとに「それらしい文章」を生成する仕組みによるものです。

文章が自然であるほど誤りに気づきにくいため、注意が必要です。

「それっぽい=正しい」ではない点が、AIの大きな特徴です。

特に、実在しない本や人物の名前が具体的に出てくる場合は、誤情報の可能性が高いため注意が必要です。

AIが間違える問題とは?なぜ誤回答が起きるのか

ChatGPTなどのAIは便利ですが、完全に正しい情報だけを返すわけではありません。

AIは「正しい答え」を理解しているのではなく、「それらしい文章」を生成しているため、誤った回答が生まれることがあります。

このように、AIが間違った内容を答えてしまう現象は、使ううえで知っておくべき重要なポイントです。

ここでは、AIが間違える主な原因をわかりやすく解説します。

情報が古い・不完全なデータで学習している

AIは過去のデータをもとに学習しているため、最新の情報を反映できないことがあります。

そのため、すでに古くなった情報や、不完全なデータをもとに回答してしまい、間違った内容になることがあります。

また、学習データに含まれていない情報については、正確に答えられないこともあります。

特に、最新ニュースや制度変更などは誤回答が起きやすいポイントです。

文脈を正確に理解していない

AIは文章のパターンから意味を推測していますが、人のように内容を理解しているわけではありません。

そのため、同じ言葉でも意味が異なる場合に、誤った解釈をしてしまうことがあります。

例えば、「ネットが切れている」という表現が、通信の問題なのか、物理的な網なのかを正しく判断できない場合があります。

このような文脈のズレが、AIの誤回答につながる原因になります。

AIが間違える質問の特徴|誤回答しやすいパターン

AIの誤回答は、質問の仕方によって発生しやすくなります。

特に、あいまいな質問や条件が不足している質問は、AIが間違えやすくなる傾向があります。

ここでは、AIが誤回答しやすい質問の特徴を具体的に解説します。

あいまいな質問(AIが間違える原因)

「おすすめを教えて」「詳しく説明して」など、条件があいまいな質問は、AIが広く解釈してしまいます。

その結果、意図とは異なる回答や、不正確な情報が含まれることがあります。

AIは質問の内容を補完しながら回答を作るため、条件が曖昧だと誤解が生まれやすくなります。

質問はできるだけ具体的にすることが重要です。

前提条件が不足している質問

日時や場所、対象などの条件が不足していると、AIは足りない情報を補って回答を作ります。

このとき、実際には存在しない情報や、誤った前提が含まれることがあります。

例えば「天気は?」と聞くよりも、「2025年2月15日の東京の天気は?」と具体的に聞く方が、正確な回答になります。

条件を明確にすることで、誤回答のリスクを減らすことができます。

専門性が高すぎる質問

医療や法律など、専門性が高い分野では、AIは推測を含む回答をすることがあります。

そのため、一見正しそうでも、実際には間違っているケースがあります。

特に専門的な内容は、AIの回答だけに頼らず、信頼できる情報源で確認することが重要です。

重要な判断に関わる内容は、必ず裏取りを行いましょう。

AIの間違いを防ぐ方法|誤回答を減らす使い方

AIの回答は便利ですが、そのまま信じるのは危険です。

使い方を工夫することで、誤回答のリスクを減らすことができます。

ここでは、すぐに実践できる対策を紹介します。

質問を具体的にする

AIは、質問が具体的であるほど正確な回答を出しやすくなります。

例えば「おすすめの本は?」ではなく、「IT初心者向けのプログラミング入門書を3冊教えてください」といったように、条件を明確にすることが重要です。

質問の内容がはっきりしているほど、AIの回答精度は高くなります。

あいまいな質問を避けることが、誤回答を防ぐ第一歩です。

複数の情報源で確認する

AIの回答だけで判断せず、複数の情報源で確認することが重要です。

特に、仕事やお金、健康に関わる内容は、公式サイトや信頼できる情報で裏取りを行いましょう。

AIは便利な補助ツールですが、最終判断は人が行う必要があります。

「参考情報」として活用する意識が大切です。

AIが間違ったことを言う理由|ハルシネーションとは

ハルシネーションとは、AIが事実ではない内容を正しいかのように回答してしまう現象のことです。

ChatGPTなどの生成AIでは、もっともらしい文章で誤った情報を出すことがあります。

これは、AIが意味を理解しているのではなく、文章のパターンから「それらしい答え」を作っているために起こります。

そのため、実在しない情報や誤った内容でも、自然な文章として出力されてしまうことがあります。

AIの回答は必ずしも正しいとは限らないため、この特性を理解して使うことが重要です。

よくある質問(FAQ)

ChatGPTはなぜ間違った回答をするのですか?

ChatGPTは「正しい答え」を理解しているのではなく、文章のパターンから回答を生成しています。

そのため、内容が自然でも、事実とは異なる情報が含まれることがあります。

AIはあくまで補助ツールとして活用することが重要です。

AIが間違える問題とは何ですか?

AIが間違える問題とは、事実とは異なる回答や不正確な情報を出してしまう現象のことです。

これは、AIが情報を理解しているのではなく、文章を生成していることが原因です。

AIが間違える質問の特徴は何ですか?

あいまいな質問や条件が不足している質問は、AIが誤回答しやすくなります。

具体的な条件を加えることで、回答の精度を高めることができます。

ChatGPTの回答は信用していいですか?

参考情報としては有用ですが、すべてをそのまま信じるのは危険です。

特に重要な情報は、公式サイトや信頼できる情報で確認することが大切です。

まとめ|ChatGPTは間違える前提で使うことが重要

ChatGPTなどのAIは非常に便利なツールですが、間違った回答をすることがあります。

実際に、事実とは異なる情報や存在しない内容を、正しいかのように説明してしまうケースもあります。

こうしたAIの誤回答を防ぐためには、質問を具体的にすることや、複数の情報源で確認することが重要です。

AIは万能ではないため、「間違えることがある」という前提で使うことが大切です。

特徴と限界を理解しながら活用することで、より安全で効果的にAIを使うことができます。